lundi, 30 novembre 2020

Comment nos neurones intègrent tous les signaux qui leur parviennent

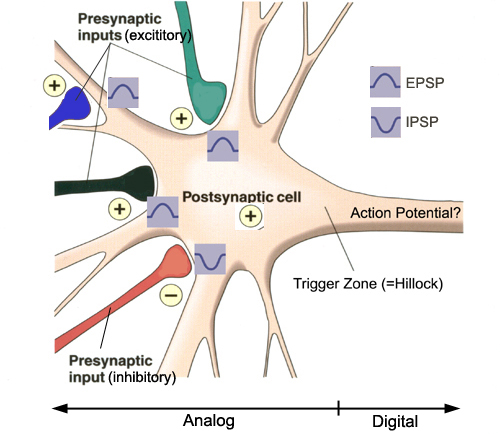

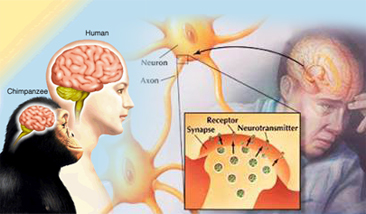

J’ai décrit un peu la semaine dernière les circonstances qui ont entouré la mise en évidence progressive de la synapse chimique durant la première moitié du XXe siècle. Et je terminais en disant que je reviendrais plus tard sur d’autres découvertes des années 1950 qui ont enrichi notre compréhension de la communication entre nos cellules nerveuses. C’est donc ce que je ferai aujourd’hui en repartant de la synapse et en exposant brièvement ce que certains ont décrit comme un « exploit remarquable de l’évolution », le fait qu’un neurone soit capable d’intégrer à tout moment la multitude de messages qu’il reçoit des autres neurones et de les retransmettre à d’autres cellules nerveuses. (suite…)

J’ai décrit un peu la semaine dernière les circonstances qui ont entouré la mise en évidence progressive de la synapse chimique durant la première moitié du XXe siècle. Et je terminais en disant que je reviendrais plus tard sur d’autres découvertes des années 1950 qui ont enrichi notre compréhension de la communication entre nos cellules nerveuses. C’est donc ce que je ferai aujourd’hui en repartant de la synapse et en exposant brièvement ce que certains ont décrit comme un « exploit remarquable de l’évolution », le fait qu’un neurone soit capable d’intégrer à tout moment la multitude de messages qu’il reçoit des autres neurones et de les retransmettre à d’autres cellules nerveuses. (suite…)

Du simple au complexe | Comments Closed

mardi, 9 janvier 2018

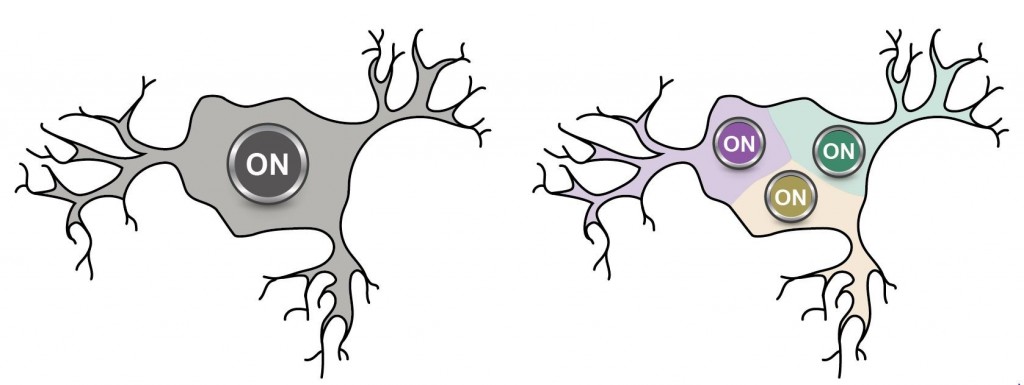

Des capacités d’intégration neuronale bien plus complexes qu’on le croyait depuis des décennies ?

Pourquoi ne pas commencer l’année avec un billet sur une découverte qui a des allures de révolution ? C’est du moins ce que laisse sous-entendre des titres comme : « Physicists Negate Century-Old Assumption Regarding Neurons and Brain Activity » ! Qu’en est-il au juste ?

Et d’abord quel phénomène neuronal serait ici remis en question ? Rien de moins que le processus de base de ce qu’on appelle l’intégration neuronale : le fait que chaque neurone fait constamment la somme de tous les inputs qui arrivent sur ses dendrites pour « décider » s’il va à son tour émettre un influx nerveux (aussi appelé potentiel d’action). (suite…)

Du simple au complexe | Comments Closed

lundi, 19 septembre 2016

« La cognition incarnée », séance 3 : Le cerveau humain : développement, communication et intégration neuronale, organisation générale

Comme à chaque lundi de cet automne, voici un bref aperçu de la prochaine séance du cours sur la « cognition incarnée » que je donnerai mercredi prochain à 18h au local A-1745 du pavillon Hubert-Aquin de l’UQAM.

Comme à chaque lundi de cet automne, voici un bref aperçu de la prochaine séance du cours sur la « cognition incarnée » que je donnerai mercredi prochain à 18h au local A-1745 du pavillon Hubert-Aquin de l’UQAM.

Et comme indiqué dans le plan de cours, après avoir fait un survol historique des grands paradigmes en sciences cognitives et remonté aux origines des êtres vivants et de la cognition la semaine dernière, on va tenter cette semaine une présentation générale du cerveau humain. [toutes les présentations Power Point en pdf des séances précédentes sont disponibles ici]

Autrement dit, comment se fabrique l’objet le plus complexe de l’univers connu dont nous avons tous et toutes, je me plais à le rappeler, un exemplaire unique entre les deux oreilles ! Il sera donc question de développement, de communication et intégration neuronale, et d’une vue d’ensemble de son organisation générale, particulièrement celle de son cortex (qui représente environ 80% du poids du cerveau humain). (suite…)

Du simple au complexe, Le bricolage de l'évolution | Comments Closed